ChatGPTの画像生成、結局なにが変わったのか — 深夜に試してわかったこと

OpenAIがChatGPTに搭載した新しい画像生成機能が、静かに、でも確実にネットの空気を変えている。

「ジブリ風」で爆発した、あの機能の正体

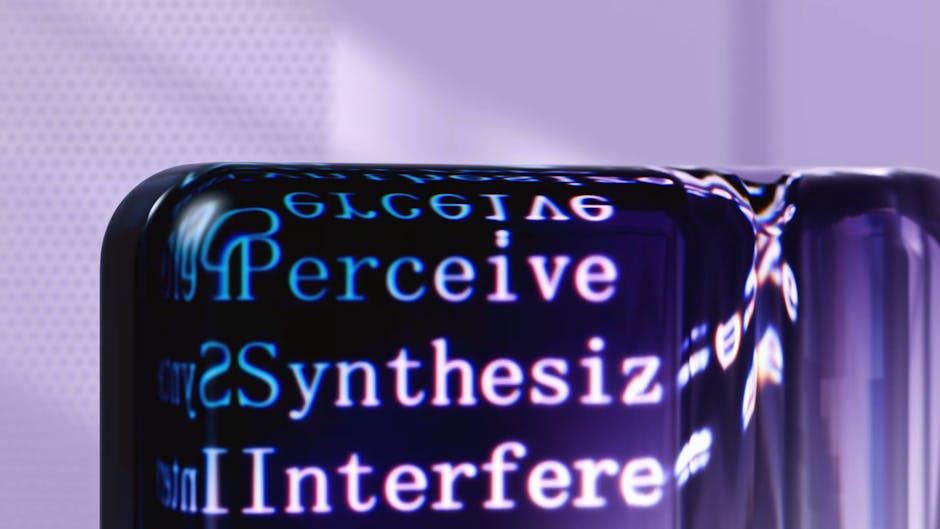

2025年3月、ChatGPTに新しい画像生成が実装された。従来のDALL-E 3とは根本的に違う。言語モデルと画像生成が別々に動いていた旧方式に対して、GPT-4oは「考える」と「描く」を一つのモデルでやる。OpenAIはこれを「4o Image Generation」と呼んでいる。

公開直後に起きたのが、あの「ジブリフィケーション」騒動だった。自分の写真をジブリ風に変換してSNSに投稿する遊びが世界中で爆発し、初週だけで130万人以上が利用したとされている。CEOのサム・アルトマン自身がXのアイコンをジブリ風に変えて火に油を注ぎ、最終的には「少し控えてほしい」とポストするほどサーバーが悲鳴を上げた。

「深夜3時にジブリ風の自分の顔を生成して、虚無感に襲われた」「面白いけど著作権的にどうなんだろう」という声がネット上では目立っていた

スタジオジブリ側は「特にコメントする事はない」と公式コメントを避けたものの、AI学習における著作権問題は今も燻り続けている。

DALL-E 3と何が違うのか

| 比較項目 | DALL-E 3(旧) | GPT-4o画像生成(新) |

|---|---|---|

| 仕組み | 言語モデルと画像モデルが別々 | 1つのモデルで会話も画像も処理 |

| テキスト描画 | 長文・複雑な書式は崩れがち | インフォグラフィックや漫画のセリフも対応 |

| 写真っぽさ | 見ればAIとわかるレベル | 独立テストでリアリティ87%相当 |

| 修正のしやすさ | ほぼ作り直し | 会話で「ここ変えて」が通じる |

| 生成速度 | 20〜45秒 | 60〜180秒(品質の代償) |

無料ユーザーでも1日3枚まで使える。Plus・Proなら3時間に40回。深夜にひとりで延々と試すには十分な回数だと思う。

Googleも本気を出してきた

OpenAIだけが盛り上がっているわけではない。Googleは2025年11月に「Nano Banana Pro」というモデルをリリースしている。Gemini 3 Proベースで、4K解像度対応、多言語テキスト描画、Google検索と連携した「視覚的ファクトチェック」まで搭載しているとの報道がある。

画像生成AIの市場は、OpenAI vs Googleの二強構図になりつつある。MidjourneyやStable Diffusionが切り開いた市場を、巨大プラットフォーマーが丸ごと飲み込もうとしている構図に見える。

翻訳も、ブラウザも — ChatGPTが「全部入り」になっていく

画像だけではない。OpenAIは2026年1月に「ChatGPT Translate」という翻訳ツールを公開した。ログイン不要、無料、50言語以上に対応。4万文字規模の長文も処理できるとされていて、DeepLやGoogle翻訳を明確に意識した設計になっている。

さらにmacOS向けには「ChatGPT Atlas」というWebブラウザまで登場したとCodeZineが報じている。検索も、翻訳も、画像生成も、ブラウジングも、全部ChatGPTに集約する。OpenAIの戦略は「ChatGPTをスマホのホーム画面にする」ことなんだろう。

「結局ぜんぶChatGPTに入れるなら、最初からそう言ってほしかった」「便利だけど依存しすぎるのが怖い」といった反応がSNS上では見られる

深夜のスマホから見える景色

深夜2時にベッドでこの記事を読んでいるあなたのスマホには、すでにChatGPTが入っているかもしれない。画像生成を試して、翻訳を使って、気づけばGoogle検索を開く回数が減っている。

それが良いことなのか悪いことなのかは、正直わからない。ただ、「AIが作った画像」と「人間が撮った写真」の区別がつかなくなる日は、思っていたよりずっと近くに来ている。ジブリ風の自画像で遊んでいた頃が、なんだか懐かしく感じる日が来るのかもしれない。

ChatGPTの画像生成、使ってみた?